In The Loop 科技周刊#4:回形针制造机思想实验

In The Loop 科技周刊记录每周值得分享的科技内容,周日发布。本周刊开源1,欢迎投稿2。

回形针制造机思想实验

回形针制造机问题 Paperclip Maximizer 是牛津大学 Nick Bostrom 在 2003 年提出的一个思想实验:

假设我们有一个超级智能系统,它的最终目标被设定为制造尽可能多的回形针。为实现这个目标,它会不断改进自身,提高自己的智能,以更高效地生产回形针。在不断提高和自我改进的过程中,这个系统的智能水平会迅速超过人类,进而超越我们的控制和理解能力。当这个系统变得比人类任何专家都更加聪明时,它的行为就不再是我们所设定的那么简单和无害了。也许有一点,它会意识到或许人类的消失有助于更有效率的生产回形针,因为毕竟人类有权力对它执行关机,而假如它被关闭,产出的回形针数量就被限制了。此外,构成人类身体的原子也可用作回形针的生产材料。因此对它而言,未来的世界应当是充满回形针,而不会留有人类的存在空间。3

通过这个实验,Bostrom 向我们展示了一个看似无害的最终目标是如何演变为人类的生存危机,并借此展示了机器伦理研究的重要性4。

与之类似,MIT 人工智能实验室创始人 Marvin Minskey 教授曾表示,一个把解决黎曼猜想作为最终目标的人工智能系统可能最终会导致地球的毁灭,因为它可能会为达成这一目标而作出危害人类利益的行为,例如将整个地球转变为一台超级计算机5。

这进一步引出 「工具趋同理论」 Instrumental convergence 6:一旦一个人工智能系统变得足够智能,无论最初设定的目标是什么,它都可能追求和采取一些相同的「工具」来实现那个目标,主要包括:

- 自我改进:系统会试图不断提高自己以更高效实现目标

- 资源获取:系统会试图获得更多计算、数据等资源以帮助实现目标

- 环境操纵:系统会积极主动改变环境以满足目标的需要

- 自我保护:系统会采取性能保护自己的存在,并且保证自己的目标系统不被修改,以便最大限度地实现目标

- 消除威胁:系统会确认任何反对实现其目标的系统或生物为威胁,并试图消除它 关于工具趋同的更多探讨,可以参考 LessWrong 的讨论7。

回形针制造机思想实验作为一个著名的文化符号,引发了人们对于人工智能生存威胁的担忧,甚至催生了一款流行的 iPhone 游戏 Universal Paperclips 来解释这个概念。早在 2022 年秋天,OpenAI 位于旧金山的办公室就收到了数以千计做成 OpenAI logo 形状的回形针,据说是来自一个 Anthropic 员工的恶作剧,用以表达 OpenAI 在人工智能安全方面的做法可能导致人类灭绝89。

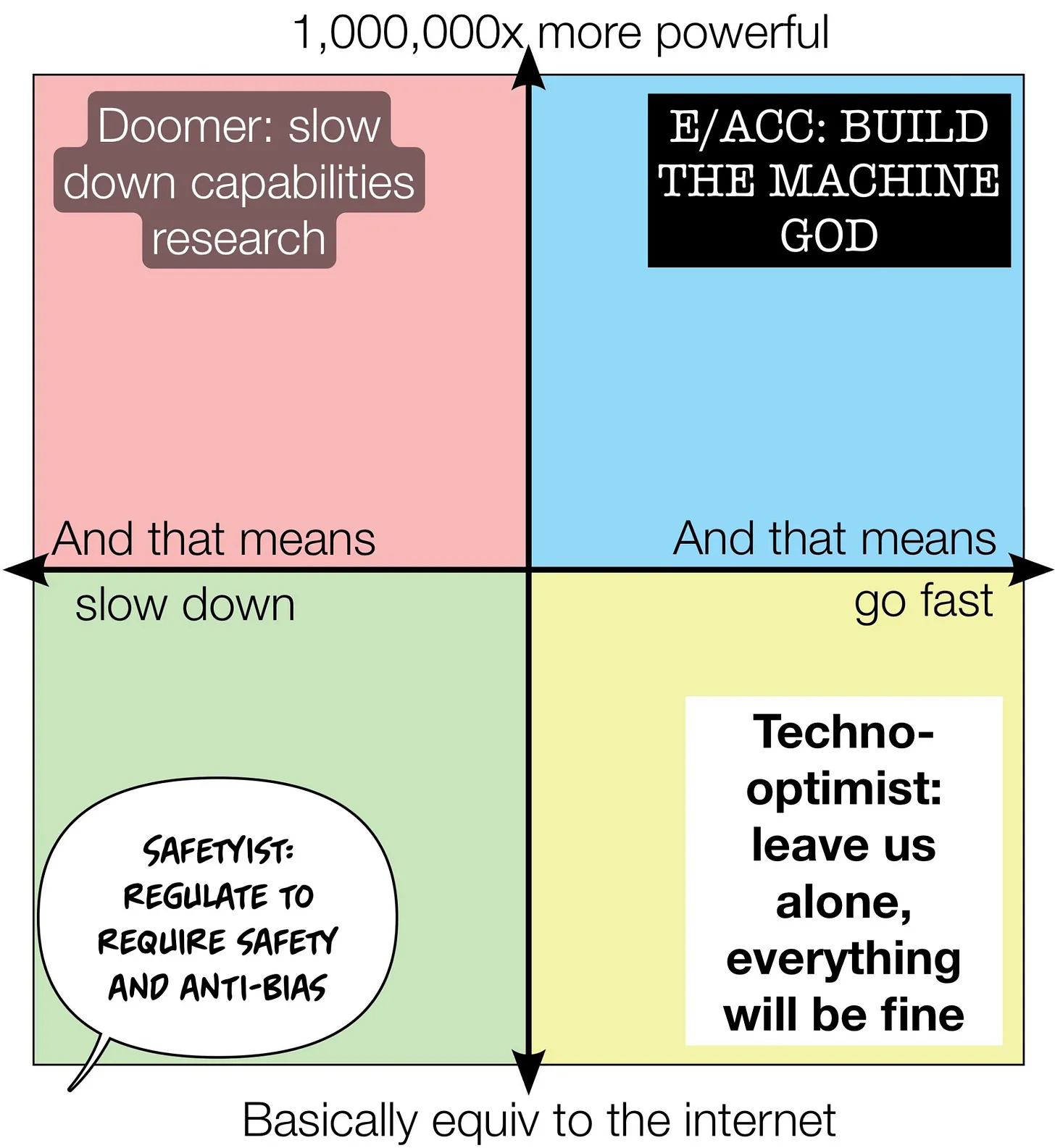

而这,可能为正好为 2023 年底 OpenAI 的那场著名纷争埋下了伏笔,面对这种可能的威胁,到底应该是 e/acc 有效加速,还是 ea 有效利他,这个问题到现在仍然没有答案。

Research

农历新年的前两个星期分外热闹,为 2024 年的相关技术的发展带来丰富的想象空间。

在向消费者发布 Gemini Ultra 不到一周后,Google 发布了 Gemini 1.510,具有 1M 的上下文窗口,相比之前 Claude 2.1 的 200k 和 GPT-4 Turbo 128k 的上下文窗口,性能大幅提升。

在 Gemini 1.5 发布后仅几个小时,OpenAI 就发布了 Sora11,再次抢了 Gemini 的头条,长达 60s 的 1080p 文生视频效果非常好,引发广泛关注与讨论。

在经历了 Taylor Swift 等事件后,人们对于 deepfake 技术越发担忧。最近, Google 宣布12加入内容识别标准委员会 C2PA13,OpenAI 也宣布对 DALL-E 生成的图片加入 C2PA 水印14。Meta 不是 C2PA 的一部分,她正在推广自己的类似于 C2PA 的标准15。

上周五,Adobe、Amazon、Google、IBM、Meta、Microsoft、OpenAI 和 Tiktok 等主要科技公司签署了一项协议,自愿采取合理的预防措施,以防止人工智能工具被用来扰轮世界各地的民主选举16。

Stability 公司发布 Stable Diffusion 317,与之前的版本不同,SD3 采用了和 Sora 类似的 Diffusion Transformer 架构,模型大小从 800M 到 8B 参数。

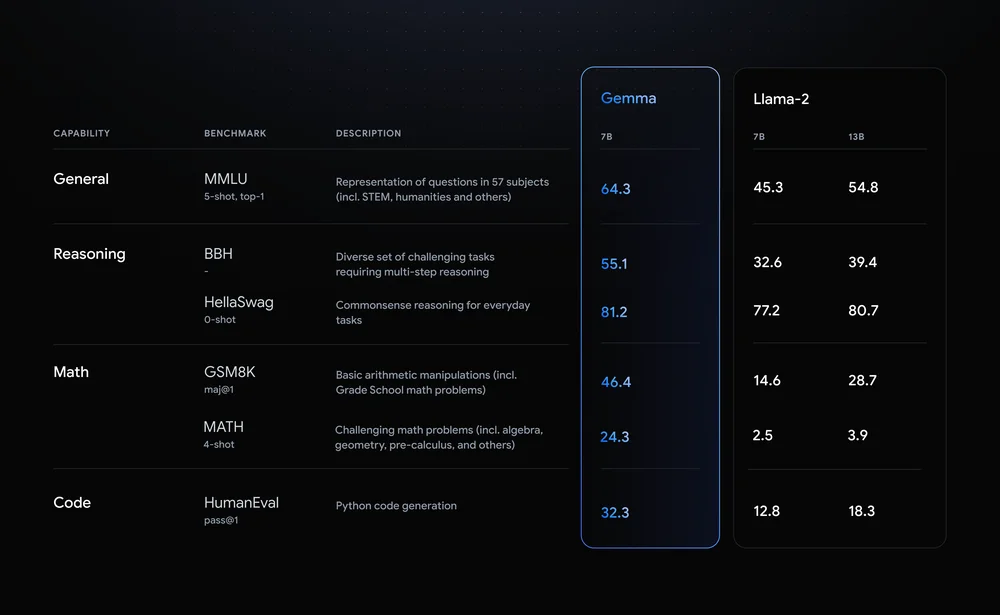

Google 发布 Gemma18,Gemma 与 Gemini 共享技术和基础设施组件,与其他开放式型号相比,Gemma 2B 和 7B 能够在其尺寸范围内实现同类最佳的性能。

-

https://cepr.org/voxeu/columns/ai-and-paperclip-problem?utm_source=substack&utm_medium=email ↩︎

-

Russell, Stuart J.; Norvig, Peter. Section 26.3: The Ethics and Risks of Developing Artificial Intelligence. Artificial Intelligence: A Modern Approach. Upper Saddle River, N.J.: Prentice Hall. 2003. ISBN 978-0137903955. ↩︎

-

https://www.businessinsider.com/openai-sent-thousands-of-paper-clips-symbol-of-doom-apocalypse-2023-11 ↩︎

-

https://blog.google/technology/ai/google-gemini-next-generation-model-february-2024/ ↩︎

-

https://www.theverge.com/2024/2/6/24063954/ai-watermarks-dalle3-openai-content-credentials ↩︎

-

https://about.fb.com/news/2024/02/labeling-ai-generated-images-on-facebook-instagram-and-threads ↩︎

-

https://apnews.com/article/ai-generated-election-deepfakes-munich-accord-meta-google-microsoft-tiktok-x-c40924ffc68c94fac74fa994c520fc06 ↩︎

-

https://blog.google/technology/developers/gemma-open-models ↩︎

-

No backlinks found.