迟到的 GB200: Blackwell 系列 GPU 演进解析

2024 年 3 月 NVIDIA 发布新的 Blackwell 系列 GPU 和 GB200 NVL72 架构,引发整个产业链的热议和分析研究。然而,因其前所未有的计算和功率密度,NVL72 系统设计带来极大复杂性,包括电力输送、过热、水冷供应链提升、快速断开连接漏水、各种电路板复杂性、Blackwell 的 CoWoS-L 封装技术设计问题,整个 2024 年都伴随着 GB200 交付延迟的消息。半年后,NVIDIA 继续拿出 GB300 系列,以应对原来的设计缺陷和市场从训练向推理专项的需求。

Blackwell 系列 GPU 产品非常丰富,本文简单梳理了其不同产品的主要特征,尝试去理解 NVIDIA 系列 GPU 从 Hopper 到 Blackwell 的进一步演进。

HGX B100/B200

在疯狂的 H100 中介绍 Hopper 系列对应的规格,这里补充上 B100 和 B200 的规格1 作为比较。可以看到:

- fp16/bf16 算力从 H100 原来 989 TFLOPS 升级到 B200 的 2250 TFLOPs,升级了 2.25 倍

- fp8 算力也从 H100 原来的 1979 TFLOPS 升级到 B200 的 4500 TFLOPS

- NVLink 带宽从原来 H100 单向 450GB/s 升级到 B200 单向 900GB/s

- HBM 从原来 H100 80GB 3.2 TB/s 升级到 192GB 8TB/s

挑出来 8 卡 B200 组成的 DGX B200 系列的规格2 如下所示:

- GPU Memory: 8 x 180GB = 1440 GB

- Training Performance: 按照 fp8 8 x 9 petaFLOPS = 72 petaFLOPS

- Inference Performance: 按照 fp4 8 x 18 petaFLOPS = 144 petaFLOPS

- NVLink Gen5:相比于 H100 的 NVLink Gen4 的双向 50GB/s,Gen5 双向带宽 100GB/s,因此同样还是 18 个 NVLink Port,总双向带宽有 1800GB/s

- GPU 网卡:8 x 400G 网络

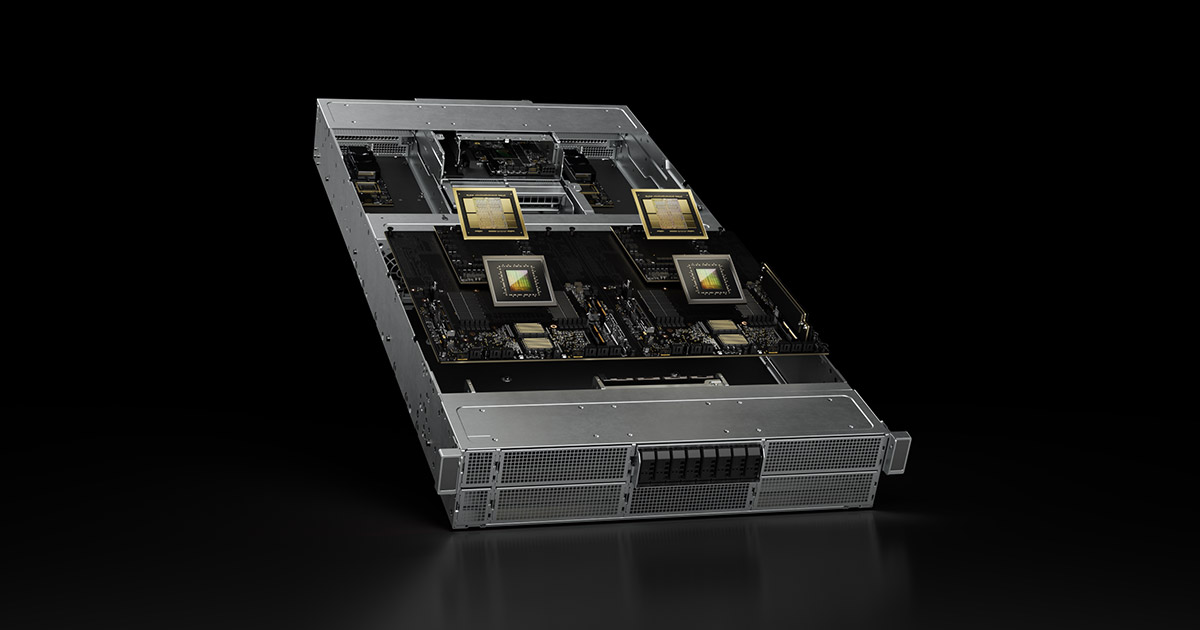

对应的 HGX base board 组成如下所示:

内存带宽可以说是从 Hopper 到 Blackwell 的最重要升级,从 H100 的 3.4 TB/s 和 H200 的 4.8 TB/s 增加到 Blackwell 系列的 8.0 TB/s,这最直接地提高了推理吞吐量和交互性。

GB200 SuperChip

GB200 则是包含一个 Grace 72 核的 ARM CPU 和 2 个 B200,如下图所示:

按照上面单卡 B200 的规格,我们可以算出对应 GB200 superchip 的规格3,以下计算按照 with sparsity 计算:

- GPU Memory: 2 x 192 GB = 384 GB,带宽为 2 x 8 = 16TB/s

- CPU Memory: 480GB,并通过 NVLink C2C 实现 CPU 与 GPU 900GB/s 带宽互联

- FP8: 按照 2 x 9 petaFLOPS = 18 petaFLOPS,实际规格 20 petaFLOPS

- FP4: 按照 2 x 18 petaFLOPS = 36 petaFLOPS,实际规格 40 petaFLOPS

- FP16:按照 2 x 4.5 petaFLOPS = 9 petaFLOPS,实际规格 10 petaFLOPS

- Networking: 每个 B200 对应一个 400G 的 CX7 网卡,因此共有两张 CX7 网卡

具体母板如下所示:

GB200 NVL2

除了上述 GB200 SuperChip 的形态,NVIDIA 还推出了 GB200 NVL2 平台4,与 GB200 SuperChip 的区别在于,其包含 2 块 Grach CPUs,同时还是保持两块 B200 GPU,采用风冷。这样可以基于 NVIDIA MGX 平台实现单节点 2 块 B200 GPU5。

实际规格计算方法与上面类似,此处不再概述:

实际性能表现:

GB200 NVL4

2024 年 11 月,NVIDIA 推出 GB200 NVL46,进一步拓展了 Blackwell 产品线,设计为低功耗的单服务器解决方案:

- GB200 NVL4 平台集成了 4 个 B200 和 2 个 Grace CPU

- 总共包含 1.3 TB 的一致性内存

相比于 GH200 NVL4,GB200 GPU 整体性能提升 2.2 倍,训练性能提升 1.8 倍。

GB200 NVL72

进一步 Scale Up,NVIDIA 还推出了 GB200 NVL72 平台78,相比于之前的 GB200 SuperChip 和 GB200 NVL2/4 母板的设计,NVL72 扩展为机架规模。整个机柜包含 18 个 Compute Tray 和 9 个 Swith Tray,也就是单个机架包含 72 个 B200 芯片全互联,即 NVL 72。

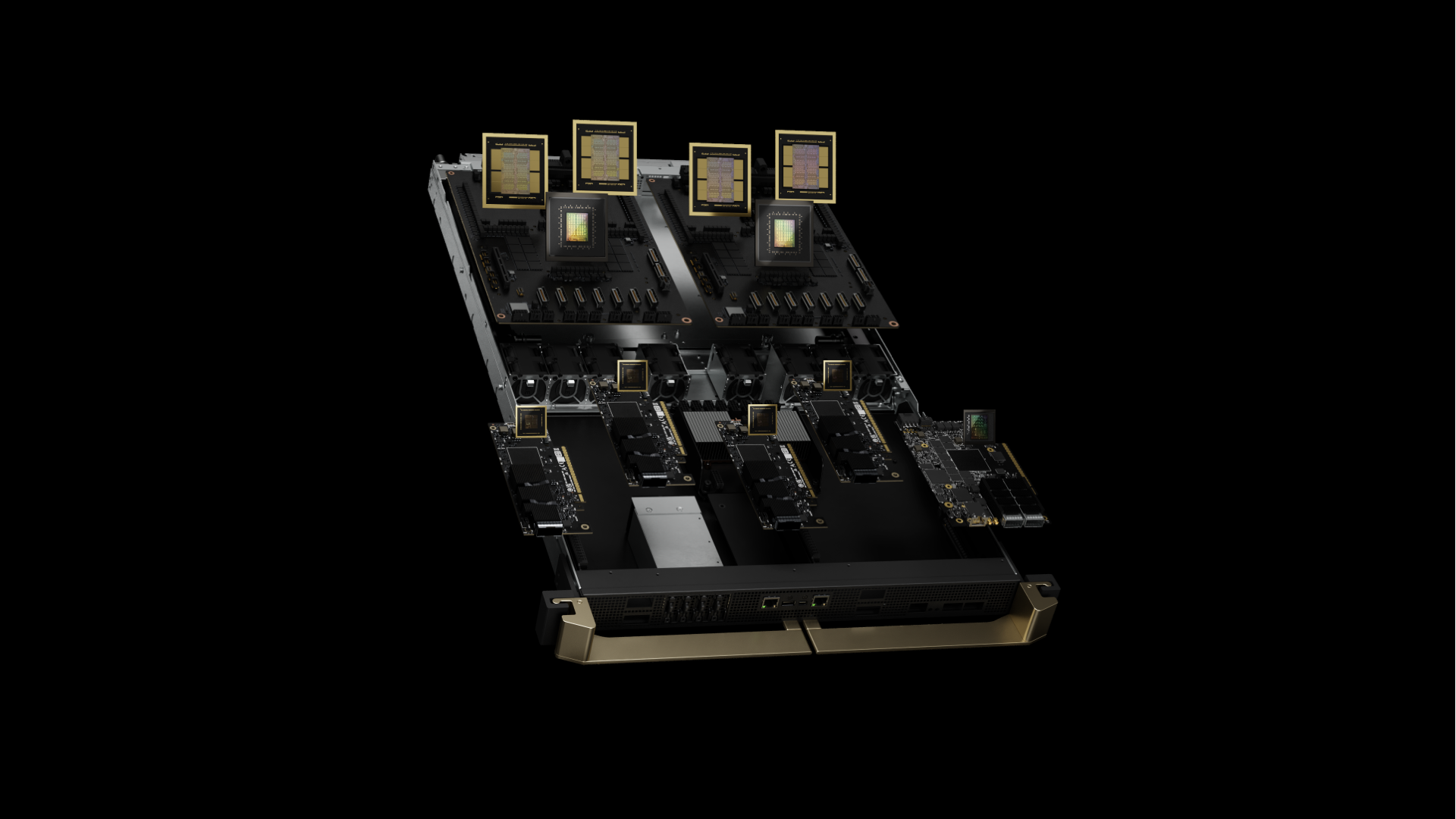

具体构造如下所示,展示了如何从 GB200,分别扩充 Compute Tray 和 NVLink Switch Tray:

具体看一个 Compute Tray:

- 2 个 GB200 芯片

- 包含 80 petaFLOPS FP4 推理算力

- 包含 40 petaFLOPS FP8 训练算力

- 包含 384GB x 2 的 GPU Memory 和 480GB x 2 的 Grace CPU Memory,也就是总共 1728 高速 Memory 可用

- 1U 液冷,最大 TDP 为 6.3 kW

- 每个 Rack 包含 18 个这样的 Compute Tray

具体看 Compute Tray 的组成,包含两个 Binaca 板,一个 Binaca 板包含两个 1200W 的 B200 和一个 Grace CPU。

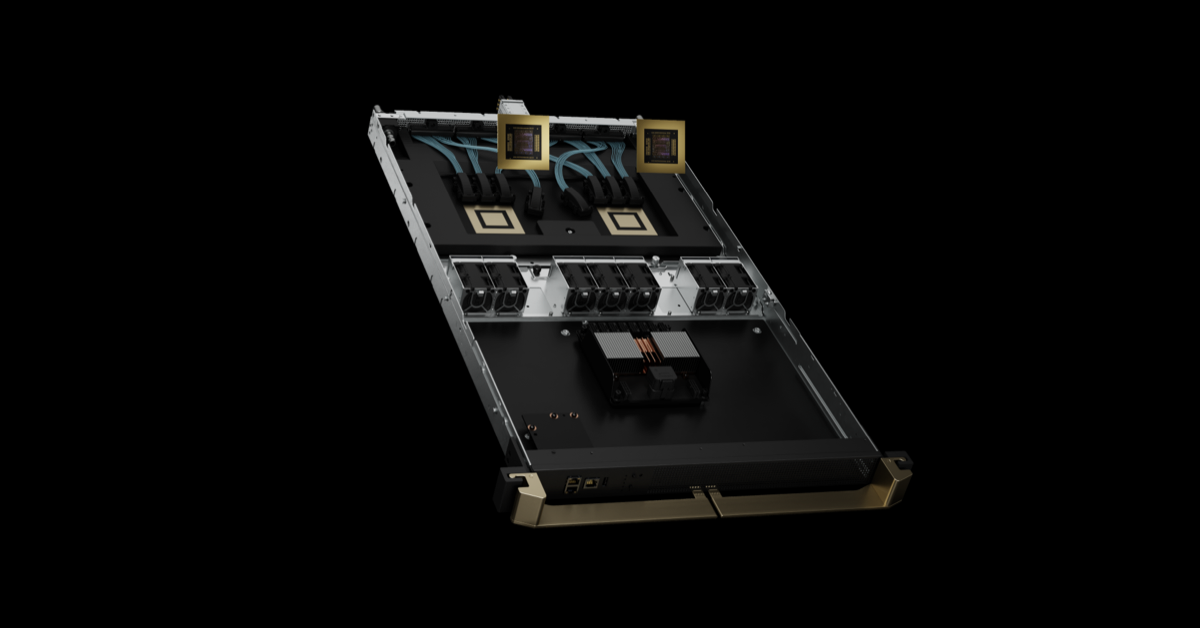

再看下 NVLink Switch Tray,组成如下所示:

每个 NVLink Switch Tray 实际组成:

- 包含 2 个 NVLink Switch

- 包含 144 个 100GB/s 的 NVLink Port,总带宽为 14.4 TB/s

- 1 U 液冷

- 整个系统对外互联上并没有采用 OSFP 的光模块接口,而是直接通过一个后置的铜线背板连接

- 每个 Rack 包含 9 个这样的 NVLink Switch Tray

因此 NVL72 系统总共 9 个 NVLink Switch Tray,总共包括 9 x 144 = 1296 个 NVLink Port,1:1 对应于 72 个 B200 x 18 个 NVLink Port。整个 NVL72 拓扑如下:

注意,在这种拓扑下,每个包含 4 个 B200 的 Compute Tray 可以视作之前常规的一个 8 卡 GPU 的计算节点,也就是一个 4 节点的计算节点。如下图所示:

再对比下总的 GB200 NVL72 和单个 GB200 SuperChip 的规格:

这里因为 NVL72 任意两个 B200 之间都有 1.8 TB/s 的 NVLink 带宽,因此总的带宽为 1.8 x 72 = 130 TB/s。

对于 GB200 NVL72,NVIDIA 推荐每个 rack 至少保留一个 Compute Tray 作为热备,也就是说至少保留一个 4 GPU 的节点作为热备。更稳妥起见,一般通常保留 2 个 Compute Tray 作为热备,这样始终有 64 个 GPU 能够稳定在跑,方便更好的并行组合(比如 TP=8、EP=8,或者 TP=4,FSDP=16)。因此 NVL72 之所以选择 72 而不是 64 或者其他的数字,都是经过精心设计和思考的。

GB200 NVL36 x 2

GB200 NVL36 x 2 是两个并排互联在一起的机架:

- 每个机架包含 9 个 Compute Tray 和 9 个 NVSwith Tray

- 在 2 个机架之间,它仍然保持 NVL72 中的所有 72 个 GPU 之间的无阻塞 all-to-all

- 这里的 Compute Tray 和 NVL72 的 Compute Tray 一样,每个节点包含 2 个 Grace CPU 和 4 个 B200 GPU

- 这里的 NVSwith Tray 包含 2 个 28.8Tb/s NVSwitch5 ASIC,包含 18 个 1.6T 双端口的 OSFP cages,水平连接到并排的另一个 NVL36 机架

- 每机架功率和冷却 密度为每机架 66kW,两个 NVL36 机架共计 132kW

- 即使总功率比 NVL72 增加了 10kW,大多数公司仍将部署 NVL36 x 2 而不是 NVL72,这是因为大多数数据中心无法支持每机架 120kW 的功耗密度

具体的 NVLink 拓扑如下所示:

- 每个 NVL36 仍然会保留一个 4 GPU 的节点作为热备

内容与标准 GB200 NVL72 类似:但 Bianca 板被替换为具有 1 个 Grace CPU 和 1 个 Blackwell GPU 的 Ariel 板。由于每个 GPU 的 Grace CPU 内容翻倍,因此与 NVL36x2 相比,此 SKU 的价格会更高

B200 NVL72 和 NVL36 x 2

2025 年第二季度将推出B200 NVL72 和 NVL36x2 规格,它们将使用 x86 CPU 而不是 Nvidia 内部的 grace CPU。这种规格称为 Miranda。

每个计算托盘的 CPU 到 GPU 的比例将保持不变,即每个计算托盘 2 个 CPU 和 4 个 GPU。

与 Grace CPU 版本相比,NVL72/NVL36x2 的这一变体将具有较低的前期资本成本,流向 Nvidia 的收入也会减少。由于它使用的是 x86 CPU,因此与 Grace C2C 相比,CPU 到 GPU 的带宽将低得多,后者可以以高达 900GB/s 的双向速度(450GB/s 单向)与 GPU 通信。

GB200 交付延迟与 B200A

整体上看,NVL72 每个机架的功耗密度大约为 125 kW,而大多数数据中心部署的标准为每机架约 12kW 到 20kW。因其前所未有的计算和功率密度,NVL72 系统设计带来极大复杂性,包括电力输送、过热、水冷供应链提升、快速断开连接漏水、各种电路板复杂性、Blackwell 的 CoWoS-L 封装技术设计问题,导致 GB200 交付延迟数个月9

在 GB200 交付延期的情况下,为了满足需求,NVIDIA 推出了一款基于 B102 芯片的 Blackwell GPU,名为 GB200A。

B200A 将用于满足低端和中端 AI 系统的需求。并将取代 HGX 8-GPU 规格的 B100 和 B200 芯片。它将采用 700W 和 1000W HGX 规格,配备高达 144GB 的 HBM3E 和高达 4 TB/s 的内存带宽。值得注意的是,这比 H200 的内存带宽要小。

B200A 还将推出 Ultra 版本。值得注意的是,它不会升级内存,但芯片可能会重新设计以提高 FLOPS。B200A Ultra 还引入了全新的 MGX NVL 36 外形尺寸。B200A Ultra 也将采用 HGX 配置,就像原来的 B200A 一样。

MGX GB200A Ultra NVL36

MGX GB200A NVL36 SKU 是一款完全风冷的 40kW/机架服务器,将有 36 个 GPU 通过 NVLink 完全互连。每个机架将有 9 个计算托盘和 9 个 NVSwitch 托盘。每个计算托盘为 2U,包含一个 Grace CPU 和四个 700W B200A Blackwell GPU,而 GB200 NVL72 / 36×2 则有两个 Grace CPU 和四个 1200W Blackwell GPU。

MGX NVL36 设计的 CPU 与 GPU 比例仅为 1:4,而 GB200 NVL72 / 36×2 的比例为 2:4。此外,每个 1U NVSwitch Tray 只有一个交换机 ASIC,每个交换机 ASIC 的带宽为 28.8Tbit/s。

由于每机架仅 40kW,MGX NVL36 可以采用空气冷却。

对于 GB200A NVL36 的 Compute Tray,组成如下:

- CPU 和 GPU 位于不同的 PCB 上,类似于 HGX 服务器的设计

- 每两个 B200A 连接 CX8 ASIC

- Grace CPU 和 Blackwell GPU 之间没有 C2C 互联

关于 NVLink 互联网络:

- 每个 GPU 的 NVLink 带宽将为单向 900Gbyte/s,与 GB200 NVL72 / 36×2 相同

- 由于只有 1 层交换机连接 36 个 GPU,因此仅需 9 个 NVSwitch ASIC 即可提供无阻塞网络。

与 GB200 NVL 72 类似, GB200A NVL36 可让一个 4 GPU 的 Compute Tray 节点处于热备用状态,并以 2、4、8、16 作为并行方案的共同因子,从而在实际工作负载中实现更高的可靠性。

GB200 NVL576

老黄声称 GB200 NVLink 可以同时连接 576 个 Blackwell GPU,下面是一种可能的实现:

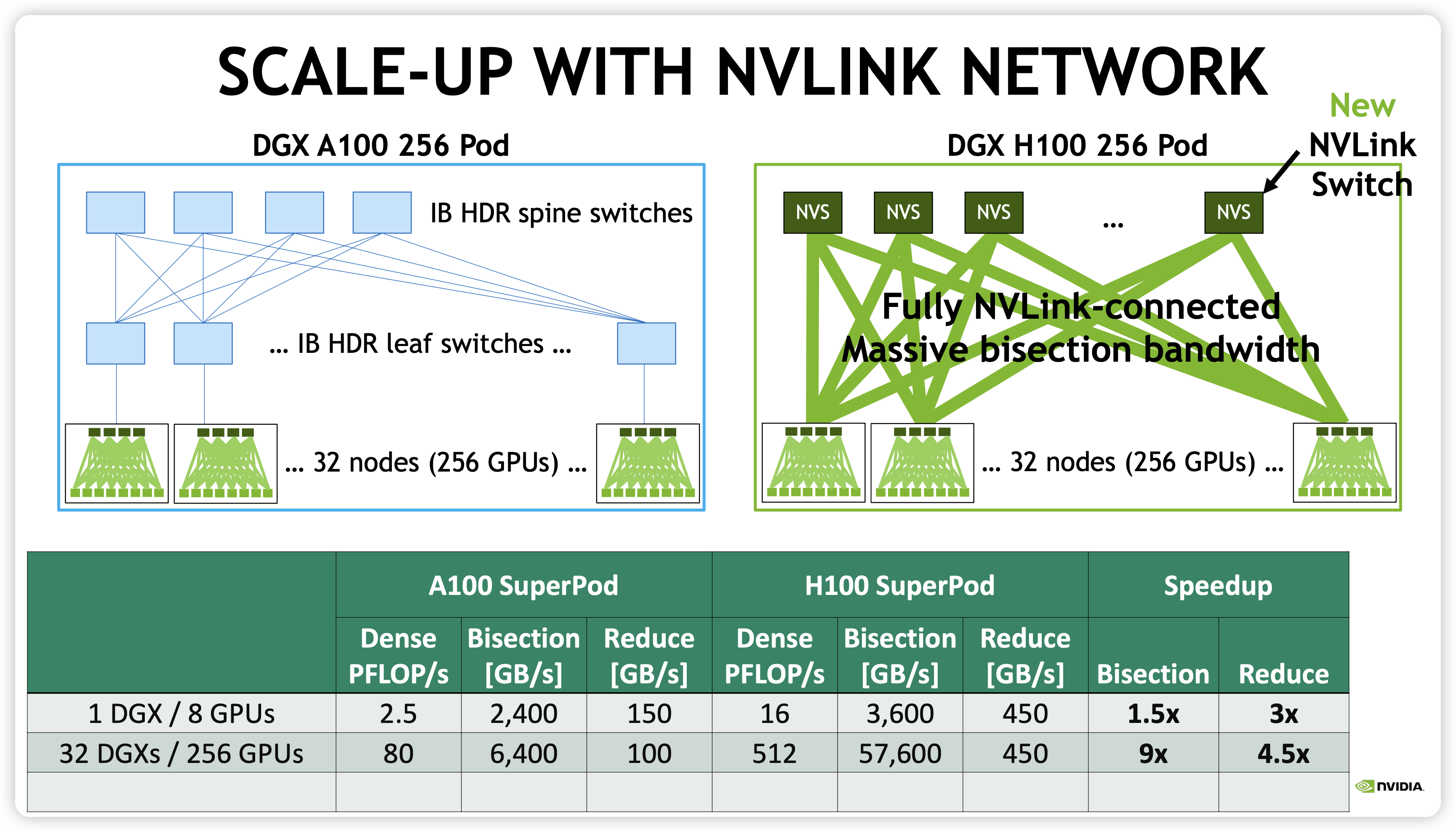

有点类似于 Hopper 系列的 NVL256:

B300 和 GB300

Nvidia 在 GB200 和 B200 发布仅 6 个月后,推出了全新的 GPU 产品 GB300 和 B30010。B300 GPU 是基于 TSMC 4NP 工艺的全新设计,计算芯片经过优化,使得产品级别的浮点运算能力(FLOPS)比 B200 提升了 50%。部分性能提升来自于功耗的增加,GB300 的 TDP 从 1.2KW 提升到 1.4KW,B300 HGX 的 TDP 从 1KW 提升到 1.2KW。

其余的性能提升来自于架构优化和系统级优化,例如 CPU 和 GPU 之间的动态功耗分配 power sloshing。动态功耗分配是指 CPU 和 GPU 之间动态重新分配功耗。

除了更多的 FLOPS,内存也升级为 12-Hi HBM3E,从 8-Hi 增加到 12-Hi,使得每个 GPU 的 HBM 容量增加到 288GB。然而,引脚速度保持不变,因此每个 GPU 的内存带宽仍为 8TB/s。

| Architecture | Blackwell | Blackwell | Blackwell | |

|---|---|---|---|---|

| GPU Name | NVIDIA B300 | NVIDIA B200 | NVIDIA B100 | |

| Manufacturing Process | TSMC 4 NP | TSMC 4 nm | TSMC 4 nm | |

| TDP | 1200 W | 1400 W | 1000 W | 1200 W | 700 W | |

| FP 64 Tensor Core | ~60 teraFLOPS | 40 teraFLOPS | 30 teraFLOPS | |

| FP 64 | ~60 teraFLOPS | 40 teraFLOPS | 30 teraFLOPS | |

| FP 32 | ~120 teraFLOPS | 80 teraFLOPS | 60 teraFLOPS | |

| FP 16/BF 16 Tensor Core | ~6.75 petaFLOPS | 4.5 petaFLOPS | 3.5 petaFLOPS | |

| INT 8 Tensor Core | ~13.5 petaFLOPS | 9 petaOPs | 7 petaOPs | |

| FP 8 Tensor Core | ~13.5 petaFLOPS | 9 petaFLOPS | 7 petaFLOPS | |

| FP 4 Tensor Core | ~27 petaFLOPS | 18 petaFLOPS | 14 petaFLOPS | |

| GPU Memory | 288 GB HBM 3 e | 192 GB HBM 3 e | 192 GB HBM 3 e | |

| Memory Bandwidth | Up to 8 TB/s | Up to 8 TB/s | Up to 8 TB/s | |

| Decoders | 7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

|

| Multi-Instance GPUs | Up to 7 MIGs @23 GB | Up to 7 MIGs @23 GB | Up to 7 MIGs @23 GB | |

| Interconnect | NVLink 1.8 TB/s | NVLink 1.8 TB/s | NVLink 1.8 TB/s | |

| NVIDIA AI Enterprise | Yes | Yes | Yes |

对比 GB200, Nvidia 还在 GB300 平台上提供了 800G ConnectX-8 NIC,提供了 InfiniBand 和以太网上两倍的 scale out 带宽。Nvidia 此前因上市时间的复杂性,取消了 GB200 的 ConnectX-8,转而使用 PCIe Gen 6 和 ConnectX-7。

ConnectX-8 相比 ConnectX-7 有巨大的改进。它不仅有两倍的带宽,还有 48 个 PCIe 通道,而不是 32 个 PCIe 通道,这使得诸如风冷 MGX B300A 等独特架构成为可能。此外,ConnectX-8 支持 SpectrumX,而在之前的 400G 世代中,SpectrumX 需要效率低得多的 Bluefield 3 DPU。

总结与展望

| Architecture | Blackwell | Blackwell | Blackwell | Hopper | Hopper | Ampere |

|---|---|---|---|---|---|---|

| GPU Name | NVIDIA B300 | NVIDIA B200 | NVIDIA B100 | NVIDIA H200 | NVIDIA H100 | NVIDIA A100 |

| Manufacturing Process | TSMC 4NP | TSMC 4nm | TSMC 4nm | TSMC 4nm | TSMC 4nm | TSMC 7nm |

| TDP | 1200 W | 1400 W | 1000 W | 1200 W | 700 W | 700 W | 700 W | 400 W |

| FP64 Tensor Core | ~60 teraFLOPS | 40 teraFLOPS | 30 teraFLOPS | 67 teraFLOPS | 67 teraFLOPS | 19.5 teraFLOPS |

| FP64 | ~60 teraFLOPS | 40 teraFLOPS | 30 teraFLOPS | 34 teraFLOPS | 34 teraFLOPS | 9.7 teraFLOPS |

| FP32 | ~120 teraFLOPS | 80 teraFLOPS | 60 teraFLOPS | 67 teraFLOPS | 67 teraFLOPS | 19.5 teraFLOPS |

| FP16/BF16 Tensor Core | ~6.75 petaFLOPS | 4.5 petaFLOPS | 3.5 petaFLOPS | 1979 teraFLOPS | 1979 teraFLOPS | 624 teraFLOPS |

| INT8 Tensor Core | ~13.5 petaFLOPS | 9 petaOPs | 7 petaOPs | 3958 teraOPs | 3958 teraOPs | 1248 teraOPs |

| FP8 Tensor Core | ~13.5 petaFLOPS | 9 petaFLOPS | 7 petaFLOPS | 3958 teraFLOPS | 3958 teraFLOPS | - |

| FP4 Tensor Core | ~27 petaFLOPS | 18 petaFLOPS | 14 petaFLOPS | - | - | - |

| GPU Memory | 288GB HBM3e | 192GB HBM3e | 192GB HBM3e | 141GB HBM3e | 80GB HBM3 | 80GB HBM2e |

| Memory Bandwidth | Up to 8TB/s | Up to 8TB/s | Up to 8TB/s | 4.8TB/s | 3.2TB/s | 2TB/s |

| Decoders | 7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

7 NVDEC 7 JPEG |

| Multi-Instance GPUs | Up to 7 MIGs @23GB | Up to 7 MIGs @23GB | Up to 7 MIGs @23GB | Up to 7 MIGs @16.5GB | Up to 7 MIGs @16.5GB | Up to 7 MIGs @ 10GB |

| Interconnect | NVLink 1.8TB/s | NVLink 1.8TB/s | NVLink 1.8TB/s | NVLink 900GB/s | NVLink 900GB/s | NVLink 600GB/s |

| NVIDIA AI Enterprise | Yes | Yes | Yes | Yes | Yes | EOL |

Note:

- 表格中的 TF32/FP16/BF16/FP8/INT8 算力都是 with sparsity

- 表格中的 NVLink 指的是双向带宽

-

https://www.exxactcorp.com/blog/hpc/comparing-nvidia-tensor-core-gpus ↩︎

-

https://resources.nvidia.com/en-us-blackwell-architecture ↩︎

-

https://nvidianews.nvidia.com/news/computer-industry-ai-factories-data-centers ↩︎

-

https://www.guru3d.com/story/nvidia-preps-gb200-nvl4-server-with-4xblackwell-gpus-and-2xgrace-cpus/ ↩︎

-

https://developer.nvidia.com/blog/nvidia-gb200-nvl72-delivers-trillion-parameter-llm-training-and-real-time-inference ↩︎

-

https://semianalysis.com/2024/08/04/nvidias-blackwell-reworked-shipment/ ↩︎

-

https://semianalysis.com/2024/12/25/nvidias-christmas-present-gb300-b300-reasoning-inference-amazon-memory-supply-chain/ ↩︎

-

No backlinks found.